在上一篇文章中,我们初步接触了Scrapy,并理解了其作为一个强大的网络爬虫框架的基础概念。从“入门”到真正能够运用它来开发有价值的项目,中间往往需要跨越一道关键的鸿沟——那就是理解其内部运行机制,并将其与具体的应用场景(如当下火热的人工智能应用软件开发)相结合。本文将围绕两大核心展开:通过一张清晰的架构图帮你构建Scrapy的宏观认知;我们将以此为基石,探讨并实践如何利用Scrapy为人工智能应用软件开发提供数据支撑。

一、一张图看懂Scrapy核心架构

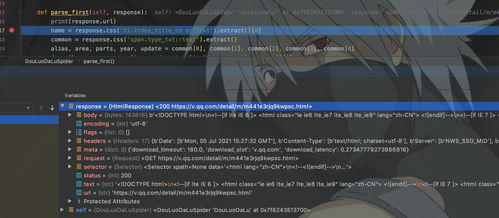

在深入代码之前,让我们先通过下图来俯瞰Scrapy的运作全貌:

[用户编写的爬虫代码] (Spider)

|

v

[Scrapy引擎] (Engine) —— 核心控制器,指挥所有组件协同工作

|

v

[调度器] (Scheduler) —— 管理待爬取的请求队列

|

v

[下载器] (Downloader) —— 执行网络请求,获取网页原始数据

|

v

[爬虫中间件 & 下载器中间件] (Spider/Downloader Middlewares) —— 处理请求/响应的钩子,用于自定义逻辑(如代理、User-Agent轮换)

|

v

[爬虫] (Spider) —— 解析响应,提取数据(Item)和新请求(Request)

|

v

[项目管道] (Item Pipeline) —— 对提取的数据进行后处理(如清洗、验证、存储到数据库或文件)工作流程简述:

1. 引擎启动:从Spider获取初始请求。

2. 调度入列:引擎将请求交给调度器排队。

3. 下载页面:引擎从调度器取出请求,通过下载器中间件后,交由下载器获取响应。

4. 解析响应:响应经过爬虫中间件后,送回Spider进行解析。Spider产生两种结果:

* 数据项(Item):需要保存的结构化数据。

- 新请求(Request):需要继续跟踪的链接。

- 数据处理:Item被送入项目管道进行深度加工和持久化;新Request则被送回引擎,重复步骤2,形成闭环。

理解这张图,你就掌握了Scrapy的“任督二脉”。它不再是黑箱,而是一个你可以精确干预和扩展的流水线。

二、实战:开发一个为AI应用服务的数据采集程序

人工智能应用,无论是机器学习模型训练还是智能分析系统,其基石往往是高质量、大规模的结构化数据。Scrapy正是自动化获取这类数据的利器。下面,我们以一个具体的例子来演示:开发一个爬虫,用于采集技术新闻数据,为后续构建一个“AI智能资讯摘要与趋势分析”应用提供原料。

步骤1:定义目标与创建项目

目标:从某个技术资讯网站(例如,一个模拟的“TechNews.com”)抓取新闻标题、摘要、发布时间、标签和详情链接。

`bash

# 1. 创建Scrapy项目

scrapy startproject ainewscrawler

cd ainewscrawler

2. 创建一个爬虫

scrapy genspider tech_news technews.example.com # 请替换为实际目标域名或使用本地测试地址`

步骤2:设计数据结构(Item)

在 items.py 中定义我们想要抓取的数据结构:

`python

import scrapy

class NewsItem(scrapy.Item):

title = scrapy.Field() # 新闻标题

summary = scrapy.Field() # 新闻摘要

publish_time = scrapy.Field() # 发布时间

tags = scrapy.Field() # 新闻标签(列表)

url = scrapy.Field() # 详情页链接

content = scrapy.Field() # 详情页全文(可选,用于更深入的AI分析)`

步骤3:编写爬虫核心逻辑(Spider)

打开生成的 tech_news.py,编写解析逻辑。这里假设目标网站列表页和详情页结构清晰。

`python

import scrapy

from ainewscrawler.items import NewsItem

from datetime import datetime

class TechNewsSpider(scrapy.Spider):

name = 'technews'

alloweddomains = ['technews.example.com']

start_urls = ['http://technews.example.com/latest']

def parse(self, response):

"""解析新闻列表页"""

# 提取列表中的每条新闻区块

newsblocks = response.css('div.news-list > article')

for block in newsblocks:

item = NewsItem()

item['title'] = block.css('h2 a::text').get()

item['summary'] = block.css('p.summary::text').get()

item['publishtime'] = block.css('time::attr(datetime)').get()

item['tags'] = block.css('div.tags a::text').getall()

detailurl = block.css('h2 a::attr(href)').get()

item['url'] = response.urljoin(detail_url)

# 重要:将Item暂存于meta,并发起对详情页的请求,以获取更多信息

yield scrapy.Request(item['url'],

callback=self.parse_detail,

meta={'item': item})

# 分页:查找并请求下一页(如果有)

nextpage = response.css('a.next-page::attr(href)').get()

if nextpage:

yield response.follow(next_page, callback=self.parse)

def parse_detail(self, response):

"""解析新闻详情页,补充数据"""

item = response.meta['item']

# 提取详情页的全文内容

item['content'] = ' '.join(response.css('div.article-body p::text').getall())

# 如果列表页没有获取到发布时间,可以在这里补充

if not item['publishtime']:

item['publishtime'] = response.css('meta[property="article:published_time"]::attr(content)').get()

# 数据补全完毕,交付给Item Pipeline

yield item`

步骤4:配置与数据处理管道(Pipeline & Settings)

在 pipelines.py 中,我们可以编写管道来清洗和存储数据。例如,存储到JSON文件(便于后续AI处理)和数据库。

`python

import json

from itemadapter import ItemAdapter

import pymongo # 假设使用MongoDB

class JsonWriterPipeline:

def open_spider(self, spider):

self.file = open('news.json', 'w', encoding='utf-8')

self.data = []

def closespider(self, spider):

json.dump(self.data, self.file, ensureascii=False, indent=2)

self.file.close()

def process_item(self, item, spider):

self.data.append(ItemAdapter(item).asdict())

return item

class MongoPipeline:

def init(self, mongouri, mongodb):

self.mongouri = mongouri

self.mongodb = mongodb

@classmethod

def fromcrawler(cls, crawler):

return cls(

mongouri=crawler.settings.get('MONGOURI'),

mongodb=crawler.settings.get('MONGODATABASE', 'ainews')

)

def openspider(self, spider):

self.client = pymongo.MongoClient(self.mongouri)

self.db = self.client[self.mongo_db]

def close_spider(self, spider):

self.client.close()

def processitem(self, item, spider):

self.db['news'].insertone(ItemAdapter(item).asdict())

return item`

在 settings.py 中启用并配置管道和中间件:

`python

ITEM_PIPELINES = {

'ainewscrawler.pipelines.JsonWriterPipeline': 300, # 优先级数字,越小越先执行

'ainewscrawler.pipelines.MongoPipeline': 800,

}

添加MongoDB配置

MONGOURI = 'mongodb://localhost:27017'

MONGODATABASE = 'ai_news'

遵守robots协议,根据实际情况调整

ROBOTSTXT_OBEY = False

设置下载延迟,避免对服务器造成压力

DOWNLOAD_DELAY = 1

启用并配置User-Agent中间件

USER_AGENT = '你的爬虫名称 (+http://www.yourdomain.com)'`

步骤5:运行与数据交付

`bash

# 运行爬虫,并将输出结构化的JSON Lines文件

scrapy crawl technews -o newsdata.jl`

生成的 news_data.jl 文件或MongoDB数据库中的记录,就是结构良好的原始数据。这些数据可以直接用于后续的AI软件开发流程,例如:

- 自然语言处理(NLP):利用摘要和全文内容训练文本摘要模型、情感分析模型或主题分类模型。

- 知识图谱构建:从标题、标签和内容中抽取实体和关系。

- 趋势分析:结合发布时间,分析不同技术话题的热度变迁。

从Scrapy到AI应用的价值链

通过“一张架构图”和“一个实战程序”,我们完成了从理解Scrapy内部原理到将其应用于具体业务场景(AI数据采集)的跨越。Scrapy不仅仅是一个爬虫工具,它更是一个高度可定制、稳健高效的数据流水线构建框架。

在人工智能应用软件开发中,数据获取与预处理是耗时最长、挑战最大的环节之一。掌握Scrapy,意味着你拥有了自动化解决这一环节的强力手段,能够将宝贵的精力聚焦于核心的算法与模型开发上。

实际开发中你会遇到更多挑战:反爬虫机制、动态加载页面、分布式抓取等。但只要你牢牢掌握其核心架构(引擎、调度器、下载器、爬虫、管道),你就能利用丰富的中间件、扩展和Scrapy生态(如Scrapy-Redis用于分布式)来应对它们。

希望本文能帮助你不仅没有“放弃”Scrapy,反而更有信心地将其作为你AI开发工具箱中的一把利剑。在数据驱动的时代,让Scrapy为你的人工智能梦想采集源源不断的“燃料”。